Ein KI-Musikgenerator kann aus einer kurzen Eingabeaufforderung in wenigen Minuten einen Beat, ein Instrumentalstück oder einen kompletten Gesangstrack erstellen. Die besten Ergebnisse erzielt man mit einem einfachen Workflow: Wähle den richtigen Stil, lege Stimmung und BPM fest, generiere ein paar Variationen und exportiere dann die Aufnahme, die zu deinem Ziel passt. Dieser Leitfaden behandelt die praktischen Schritte, die Struktur der Eingabeaufforderung und die abschließenden Überprüfungen, die KI-Musik brauchbar und nicht zufällig erscheinen lassen.

Von hier aus gehen wir von der Definition des Gesamtbildes zu dem Teil über, der am wichtigsten ist: wie man das Briefing festlegt, den richtigen Workflow auswählt und entscheidet, wo MelodyCraft passt, wenn Sie einen brauchbaren Entwurf anstelle einer zufälligen ersten Aufnahme wünschen.

Benötigst du einen schnelleren Weg, um Prompts in Musik zu verwandeln?

Nutze MelodyCraft, um Songs zu skizzieren, Ideen zu testen und einen saubereren ersten Entwurf in kürzerer Zeit zu exportieren.

Was ist ein KI-Musikgenerator und was kann er heutzutage erstellen?

Ein KI-Musikgenerator ist eine Software, die Musik aus Eingaben wie Textaufforderungen, Liedtexten oder Referenz-Audio erstellt. Die heutigen Tools können Folgendes generieren:

Instrumentals / Hintergrundmusik (wiederholbare Cues, Lo-Fi-Betten, cineastische Texturen)

Beats und vollständige Arrangements (Intro/Strophe/Refrain-artige Abschnitte)

Songs mit Gesang (Melodie + gesungener Gesang, manchmal mit Harmonien)

Texte (optional) in einigen KI-Songgenerator-Workflows

Die Grenze: KI kann schnell und überraschend musikalisch sein, aber sie garantiert keine perfekte Kontrolle. Du erhältst möglicherweise nicht jedes Mal genau die Melodie, die du im Kopf hast, eine fehlerfreie Aussprache oder ein studioreines Mixing. Betrachte sie als eine Art "Entwurfmaschine", die immer noch von menschlicher Führung (Prompting) und leichter Nachbearbeitung profitiert.

Eine weitere wichtige Einschränkung ist die Konsistenz: Derselbe Prompt kann bei verschiedenen Versuchen zu unterschiedlichen Ergebnissen führen. Deshalb ist ein Workflow, der Variationen, Auswahlkriterien und kleine Änderungen beinhaltet, wichtiger als der Versuch, den perfekten Track mit einem einzigen Versuch zu erstellen.

Text-to-Music vs. KI-Songgenerator: Was ist der Unterschied?

In der Praxis verwenden die Leute „KI-Musikgenerator“ für beides. Aber der Anwendungsfall ist der sauberste Weg, um sie zu trennen:

Wenn Sie 15–60 Sekunden „nicht ablenkende“ Musik benötigen, reicht Text-zu-Musik normalerweise aus. Wenn Sie einen Refrain wollen, an den sich die Leute erinnern, befinden Sie sich im Bereich der KI-Songgeneratoren.

Die Eingaben, die Ihre Ergebnisse am meisten beeinflussen (Genre, Stimmung, BPM, Struktur)

Wenn Sie bessere Ergebnisse von einem KI-Musikgenerator erzielen möchten, priorisieren Sie Strukturwörter, BPM und Stimmung gegenüber langen Listen von Instrumenten.

Warum? Modelle können High-Level-Constraints zuverlässiger „folgen“ als Mikro-Anweisungen. Ihm zu sagen, wo der Refrain hinkommt (und wie er sich anfühlen soll), gibt der Engine eine Karte. Eine riesige Instrumentenliste erzeugt oft Unordnung, Konflikte und matschige Mischungen.

Konzentriere dich zuerst auf diese Eingabeblöcke:

Genre + Subgenre: „Indie-Pop“, „Trap“, „Cinematic Ambient“

Stimmung + Energieverlauf: „erhebend“, „angespannt“, „warm und intim“, „explosiver Refrain“

BPM (oder Tempo-Gefühl): „92 BPM“, „schnelle 140 BPM“, „Half-Time-Feeling“

Struktur-Wörter: „Intro / Strophe / Pre-Chorus / Refrain / Bridge / Outro“

Gesangsnotizen (falls erforderlich): „weiblicher Alt“, „hauchend“, „saubere Aussprache“, „kein Rap“

Mix-Notizen (leichte Berührung): „druckvolle Drums“, „sauberes Low-End“, „breiter Refrain“

Wenn Ihre Eingabe ignoriert wird, kürzen Sie sie – und verschieben Sie dann die wichtigsten 6–10 Wörter an den Anfang.

Wie man mit einem KI-Songgenerator Musik erstellt (ein schrittweiser Workflow)

Dies ist eine praktische, wiederholbare Methode, um mit einem KI-Songgenerator Musik zu machen – egal, ob Sie Content-BGM oder einen vollständigen Gesangstrack erstellen. Jeder Schritt enthält ein Ziel, eine Anleitung, häufige Fehlerquellen und eine realistische Zeitschätzung.

Schritt 1 – Wähle eine Referenz: Was der Zuhörer in 10 Sekunden fühlen soll

Ziel: Entscheide, welchen emotionalen „Schnappschuss“ dein Track schnell vermitteln muss.

So geht's: Schreibe ein kurzes Briefing in einer Zeile mit Stimmung + Nutzung + Plattform. Beispiele:

“Erhebender Indie-Pop für ein YouTube-Kanal-Intro”

“Dunkler minimalistischer Techno für eine Fashion-Reel”

“Warmer Lo-Fi für ein Podcast-Bett unter Dialogen”

Wenn möglich, definieren Sie auch die ersten 10 Sekunden: Ist es ein Cold Open mit Schlagzeug? Ein sanftes Pad-Fade-In? Ein Hook-Teaser?

Häufige Fehlerquelle: Alles beschreiben außer dem Gefühl des Zuhörers. „Synthesizer, Gitarren, Bass, Schlagzeug“ ist keine Kurzbeschreibung. „Selbstbewusst, hell, vorwärts“ ist es.

Geschätzte Zeit: 3–5 Minuten.

Schritt 2 – Eine Prompt schreiben, der ein Modell folgen kann (Vorlage zum Kopieren und Einfügen)

Ziel: Wandeln Sie Ihre kreative Absicht in Einschränkungen um, die die KI ausführen kann.

So geht das: Verwenden Sie eine Vorlage, die einheitlich und leicht zu überfliegen ist. Beschränken Sie sich auf einen "Spine"-Stil und fügen Sie dann ein paar wirkungsvolle Details hinzu.

Copy-Paste-Prompt-Vorlage (universal): Genre + Epoche + BPM + Instrumente + Struktur + Gesangsnotizen + Mix-Notizen

Beispiel 1 (instrumental / Content-BGM): Indie Electronic, 2010er, 108 BPM. Helle, pluckige Synthesizer, knackige Kick, leichte Gitarren-Chops. Struktur: Intro 4 Takte, Build 8 Takte, Drop 16 Takte, kurzer Breakdown 8 Takte, finaler Drop 16 Takte, sauberes Outro. Keine Vocals. Mix: druckvolle Drums, saubere Bässe, luftige Höhen, loopfähiges Ende.

Beispiel 2 (vollständiges Lied mit Gesang): Moderner Pop-Rock, Einfluss der frühen 2000er, 96 BPM. Knackige Gitarren, stabiles Schlagzeug, warmer Bass. Struktur: Intro, Strophe 1 (spärlich), Pre-Chorus (Anhebung), Chorus (großer Hook), Strophe 2, Chorus, Bridge (Half-Time), finaler Chorus. Gesang: männlicher Tenor, klare Aussprache, emotional, aber nicht verhaucht, kein Rap. Mix: breiter Chorus, zentrierter Gesang, minimaler Hall auf den Strophen.

Häufige Fehlerquelle: Übermäßiges Styling („traumhafter cineastischer Trap-Hyperpop-Jazz-Funk“), das die Ausgabe instabil macht.

Geschätzte Zeit: 5–10 Minuten.

Schritt 3 – Variationen generieren und Takes wie ein Produzent auswählen (nicht wie bei einer Lotterie)

Ziel: Optionen erstellen, dann bewusst wählen.

So geht es: Erstelle 3–6 Variationen desselben Prompts. Ändere nicht fünf Variablen auf einmal, sondern nur eine Sache pro Iteration (BPM, Gesangstyp oder Strukturdetail).

Dann bewerte jede Aufnahme schnell:

Häufige Fehlerquelle: Eine "coole" Herangehensweise beibehalten, die Ihr eigentliches Ziel verfehlt (z. B. eine Podcast-Einleitung, die zu stark Aufmerksamkeit erregt).

Geschätzte Zeit: 10–20 Minuten.

Schritt 4 – Struktur überarbeiten: Abschnitte erweitern, Liedtexte umschreiben und Wiederholungen vermeiden

Ziel: Das Lied soll sich intentional anfühlen, nicht wie eine Schleife.

Vorgehensweise (Reihenfolge ist wichtig):

Zuerst die Struktur festlegen (Intro/Strophe/Refrain/Bridge/Outro und ungefähre Längen).

Texte umschreiben, um sie an die Abschnitte anzupassen (Strophen = Geschichte/Detail; Refrain = Zusammenfassung/Slogan; Bridge = Kontrast).

Bestimmte Abschnitte neu generieren oder erweitern, um Kontrast hinzuzufügen (andere Drums, Harmonieverschiebung, Half-Time).

Häufige Lösungen für Schwachstellen bei KI-Songgeneratoren:

Refrain wiederholt sich zu oft: Spezifizieren Sie „finaler Refrain mit zusätzlicher Harmonie und größeren Drums“ oder „zweiter Refrain kürzer, fügen Sie Vocal-Ad-libs hinzu“.

Texte schweifen vom Thema ab: Reduzieren Sie das Thema auf einen Satz und wiederholen Sie die Schlüsselbilder.

Abschnitte sind nicht offensichtlich: Beschriften und beschreiben Sie explizit den Unterschied („Strophe spärlich, Refrain groß und breit, Bridge Half-Time“).

Häufige Fehlerquelle: Zuerst Liedtexte schreiben und dann versuchen, nachträglich eine Struktur zu erzwingen. Dies führt oft zu umständlichen Formulierungen und sich wiederholenden Hooks.

Geschätzte Zeit: 15–30 Minuten.

Schritt 5 – Export für die Bearbeitung: WAV vs. MP3, Stems und was zu tun ist, wenn keine Stems verfügbar sind

Ziel: Exportiere die richtigen Dateien für deinen nächsten Schritt (Posten vs. Bearbeiten).

Wie man auswählt:

WAV: besser für Bearbeitung und Mastering (weniger Kompressionsartefakte).

MP3: gut für schnelle Vorschauen und Entwürfe.

Stems (falls verfügbar): am besten für echtes Mischen (Gesang lauter/leiser, Drum-Punch usw.).

Wenn keine Stems verfügbar sind, kannst du einen Track trotzdem mit "Mastering-Style"-Bearbeitungen verbessern:

EQ-Bereinigung (Rumpeln entfernen, scharfe Höhen zähmen)

Kompression/Limiting (Peaks kontrollieren, die empfundene Lautstärke sanft erhöhen)

Schneiden und neu anordnen (lange Intros kürzen, sich wiederholende Abschnitte verkürzen, ein sauberes Ende schaffen)

Häufige Fehlerquelle: Eine MP3 zu stark bearbeiten und sich dann wundern, warum sie verwaschen klingt – ernsthafte Arbeiten wenn möglich mit WAV-Dateien durchführen.

Geschätzte Zeit: 5–15 Minuten.

Eingabeaufforderungs-Tipps, die die KI-Musikqualität tatsächlich verbessern (von echten Nutzern)

Der größte Qualitätssprung kommt normalerweise von wie du schreibst, nicht von welchem Plugin du dir vorstellst. Community-Prompt-Anleitungen stimmen in der Regel in drei Themen überein: Wortreihenfolge, klare Tags und Zurückhaltung. Wenn du eine tiefe, reale Prompt-Aufschlüsselung möchtest, ist dieser Community-Thread ein guter Ausgangspunkt: aktualisiertes Master-Prompting-Dokument.

Nutze dieses einfache Do/Don’t-Set, um deine Prompts zu optimieren:

Eine Prompt-Architektur, die funktioniert: ein "Rückgrat" + eine "Farbe"

Ein zuverlässiges Muster ist Wirbelsäule + Farbe:

Spine = die Hauptidentität (Genre + Epoche + Tempo-Feeling)

Color = eine Wendung (ein charakteristisches Instrument, eine Produktionstextur oder ein rhythmisches Gefühl)

Beispiel:

Spine: „moderner R&B, 88 BPM, intim“

Color: „weiche Rhodes + knackige 808s, Late-Night-Vibe“

Dies vermeidet das Problem der „Genre-Suppe“, bei dem der KI-Musikgenerator versucht, widersprüchliche Anweisungen zu erfüllen, und am Ende einen trüben Kompromiss eingeht.

Die 5 Tags, die es wert sind, getestet zu werden: BPM, Ära, Gesangstyp, Produktionsstil, Ausschlüsse

Wenn Sie nur Zeit haben, ein paar Variablen zu testen, testen Sie diese – denn sie steuern die Ausgabe oft am vorhersehbarsten:

BPM / Tempo-Gefühl: „120 BPM“ vs. „120 BPM, Half-Time-Gefühl“

Ära: „80er“, „frühe 2000er“, „2010er“

Gesangstyp: „weiblicher Alt“, „männlicher Bariton“, „weich und gehaucht“ (bei Verwendung eines KI-Songgenerators)

Produktionsstil: „trocken und direkt“, „breiter Chorus“, „Lo-Fi-Kassettenwärme“

Ausschlüsse (negative Absicht): „kein Rap“, „kein starker Hall“, „verzerrte Gitarren vermeiden“

Verwende Ausschlüsse sparsam und deutlich. Nicht jedes Modell unterstützt formale „Negative Prompts“, aber einfache „kein X“-Einschränkungen helfen oft, unerwünschte Eigenschaften zu reduzieren.

Warum Ihre Ausgabe verwaschen oder verzerrt klingt (und wie Sie dies in der Eingabeaufforderung verhindern können)

Viele „schlechte Ausgaben“ sind vorhersehbar: zu viele Elemente, widersprüchliche Stile oder Energiewörter, die alles auf Maximum setzen. Hier ist eine praktische Tabelle mit Korrekturen.

Möchten Sie Ideen einfacher in fertige Tracks umwandeln?

Wenn Sie einen brauchbaren ersten Entwurf anstelle von endlosem Optimieren benötigen, hält MelodyCraft den Workflow einfach.

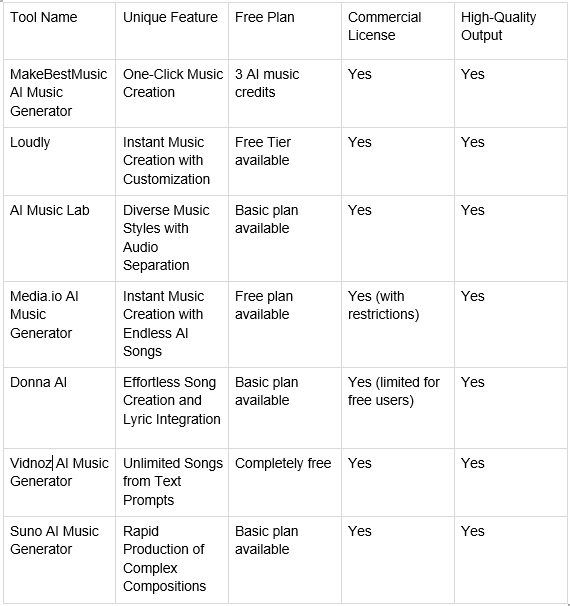

Welchen KI-Musikgenerator solltest du wählen? Eine praktische Vergleichs-Checkliste

Wenn Sie nach „beste KI-Musikgeneratoren“ suchen, finden Sie lange Listen (wie diese Übersicht über KI-Musikgenerator-Optionen). Listen sind nützlich, aber Ihre beste Wahl hängt davon ab, was Sie erstellen und wie Sie arbeiten.

Verwenden Sie diese Checkliste, um jeden KI-Musikgenerator oder KI-Songgenerator in weniger als 15 Minuten zu bewerten:

Wenn du einen Ort suchst, um schnell Ideen zu entwerfen und in fertige Tracks zu verwandeln, solltest du MelodyCraft als deine "Kreativzentrale" in Betracht ziehen – besonders, wenn du Wert auf schnelle Iteration von Prompt → Versionen → Export legst.

Wenn du Gesang und komplette Songs brauchst: Was du in den ersten 10 Minuten testen solltest

Führen Sie einen schnellen „Same-Prompt-Stresstest“ durch, bevor Sie sich für ein Tool entscheiden:

Verwende eine Eingabeaufforderung (Struktur + Gesangstyp enthalten).

Generiere 3 Aufnahmen.

Vergleichen:

Diktion (sind die Wörter verständlich?)

Melodie-Konsistenz (fühlt sich der Refrain wie die gleiche Songidee an?)

Hook-Einprägsamkeit (bleibt nach einmaligem Hören etwas hängen?)

Abschnittskontrast (Unterschied zwischen Strophe und Refrain)

Wenn Aufnahme 1 großartig ist, Aufnahme 2–3 aber zusammenbrechen, ist das Tool möglicherweise schwieriger für die Produktionsarbeit zu steuern.

Wenn du nur Hintergrundmusik brauchst: Wie man Schleifbarkeit und Rhythmus optimiert

Für Content-BGM ist die Gewinnbedingung anders: Sie wollen Musik, die Sprache/Dialoge unterstützt und sauber geschnitten werden kann.

Prompt-Muster, die helfen:

“loopfähiges Ende,” “nahtlose Schleife,” “kein langes Ausblenden”

“minimale Lead-Melodie,” “unterstützende Texturen”

“Platz für Dialog lassen,” “Mitteltonbereich nicht überfüllt”

“gleichmäßiger Groove, subtile Variation alle 8 Takte”

Wähle auch eine Struktur, die Redakteure lieben: 4–8 Takte lange Phrasen, vorhersehbare Übergänge und eine saubere „Button Ending“-Option.

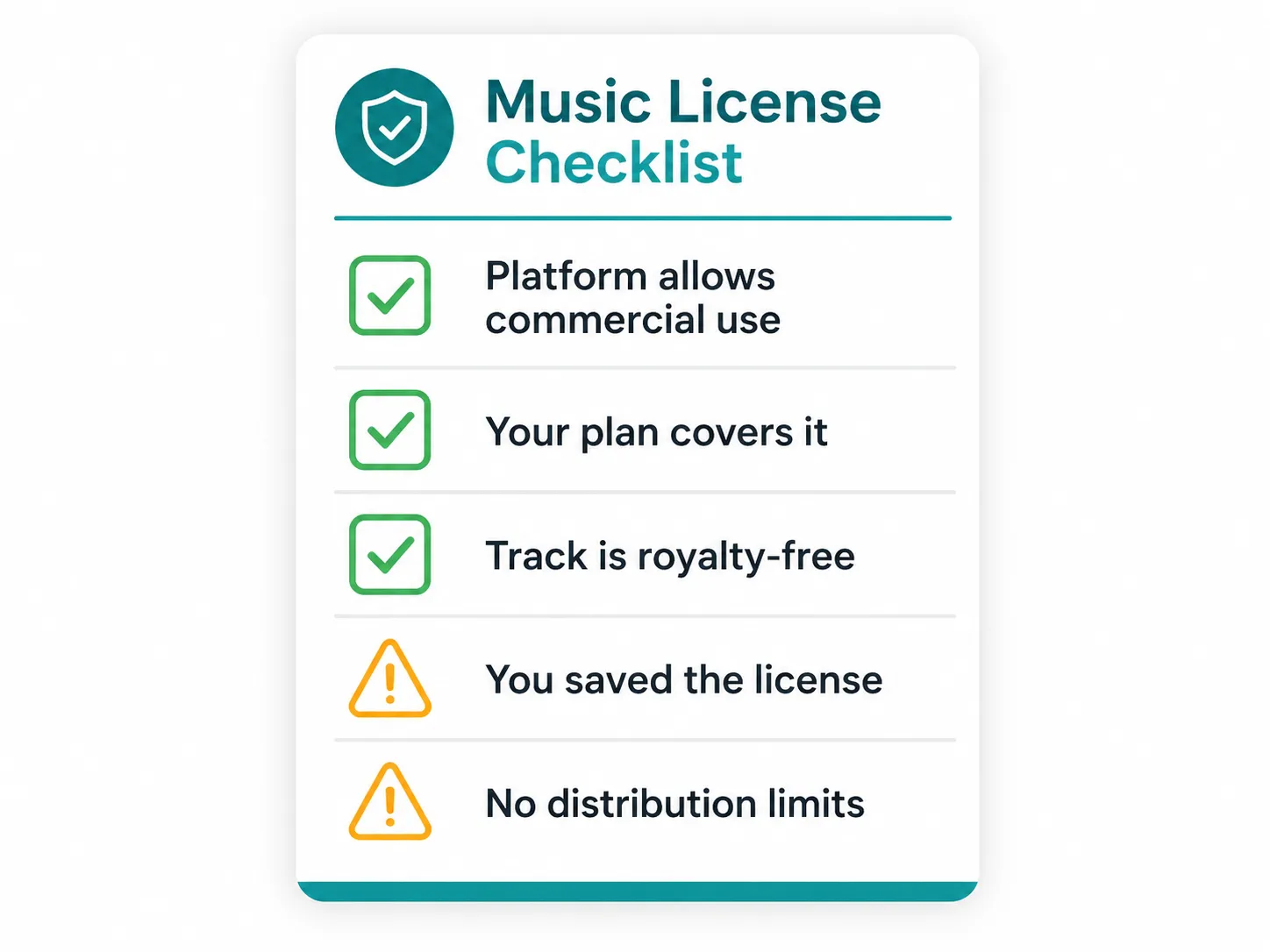

Kann man KI-generierte Musik kommerziell nutzen? Was man vor der Veröffentlichung prüfen sollte.

Sie können KI-generierte Musik oft kommerziell veröffentlichen – aber die sichere Antwort ist: es hängt vom Tool, Ihrem Plan und der Plattform ab. Bevor Sie auf Spotify/YouTube/TikTok hochladen, führen Sie eine kurze Checkliste durch:

Bestätigen Sie Ihre Lizenz/Rechte für Ihre spezifische Kontostufe (kostenlos vs. kostenpflichtig)

Prüfen Sie, ob Weiterverbreitung erlaubt ist (Streaming, Beats verkaufen, Kundenaufträge)

Beweise speichern: Quittungen, Planstatus, Zeitstempel, Projekt-IDs

Vermeiden Sie "ähnlich klingende" Prompts, die einen bestimmten Künstler oder Song imitieren

Seien Sie darauf vorbereitet, dass Plattformsysteme (wie Content ID) Ähnlichkeiten erkennen

Dieser Hilfeartikel ist ein gutes Beispiel dafür, wie sich Planbedingungen auf Rechte auswirken können: Suno – Übersicht zur kommerziellen Nutzung. Überprüfen Sie immer die genauen Bedingungen für das von Ihnen verwendete Tool.

Eigentum und Lizenzierung können von Ihrem Plan abhängen (kostenlos vs. kostenpflichtig).

Viele Tools knüpfen kommerzielle Rechte an Ihre Abonnementstufe. Einige erlauben die persönliche Nutzung mit kostenlosen Plänen, schränken aber die Monetarisierung, Kundenarbeit oder Weiterverbreitung ein, es sei denn, Sie haben einen kostenpflichtigen Plan. Andere gewähren umfassendere Rechte, fügen aber Bedingungen hinzu (Nennung, Nutzungslimits oder Einhaltung von Richtlinien).

Neutrale Best Practice:

Screenshot-Schlüsselbegriffe zum Zeitpunkt der Veröffentlichung

Speichern Sie Ihre Rechnung/Quittung und das Erstellungsdatum

Führen Sie einen einfachen "Release-Ordner" mit exportierten Dateien und Notizen

Ein konkretes Beispiel für planbasierte Sprache finden Sie in den offiziellen Richtlinien des Tools (z. B. die Lizenzhinweise von Suno) und gleichen Sie diese mit Ihrer beabsichtigten Verwendung ab.

Bedingungen, die Sie lesen sollten (insbesondere für Weiterverbreitung, Lizenzen und Einschränkungen)

Auch wenn Sie die Bedingungen sonst nie lesen, überfliegen Sie diese Abschnitte vor der kommerziellen Veröffentlichung:

Inhaltsurheberschaft / Lizenzgewährung

Beschränkungen (verbotene Inhalte, Imitation, Scraping)

Weiterverbreitung (Verkauf, erneutes Hochladen, Kundenergebnisse)

DMCA / Streitigkeiten und wie Ansprüche behandelt werden

Rückerstattungs- / Stornierungs-Klauseln

Wenn Sie Udio verwenden oder evaluieren, beginnen Sie mit den offiziellen Udio-Bedingungen. Für Teams lohnt es sich, endgültige Veröffentlichungen durch eine kurze interne rechtliche Checkliste zu leiten – insbesondere für bezahlte Anzeigen, Markenkampagnen oder große Verbreitung.

Vermeidung von Content ID-Ansprüchen und "ähnlich klingenden" Risiken: Eine Checkliste für Urheber

Sie können Risiken reduzieren, ohne die Kreativität zu ersticken:

Nennen Sie in Prompts keine spezifischen Künstler, Bands oder Songs

Verwenden Sie stattdessen Stilbeschreibungen („2000er Pop-Punk“, „gefühlvolle R&B-Ballade“) anstatt „im Stil von …“

Generieren Sie mehrere Takes und schreiben Sie die Texte um (vermeiden Sie die Wiederverwendung derselben Hook-Phrasen)

Erwägen Sie einen leichten zweiten Arrangement-Durchgang (neues Intro, anderes Drum-Pattern, hinzugefügte Bridge)

Wenn Sie sich nicht sicher sind, veröffentlichen Sie eine stärker transformierte Version (Bearbeitung + neue Elemente)

„Klingt-wie“-Prompts können die Wahrscheinlichkeit von Ansprüchen oder Entferungen erhöhen. Wenn Sie Zweifel haben, verwenden Sie eine breitere Genresprache und originellere lyrische Ideen.

Für mehr Kontext zu plattformseitigen Einschränkungen und Richtlinien kann es hilfreich sein, die Nutzungsbedingungen eines Tools zu überprüfen (zum Beispiel die Nutzungsbedingungen von Suno) und Ihren Workflow entsprechend anzupassen.

Wie man Musik ohne KI macht (die Grundlagen, die KI-Tracks immer noch besser machen)

Ein wenig Musiktheorie zu kennen macht dich nicht weniger "KI-gestützt" – es macht deine Prompts spezifischer und erfolgreicher. Wenn du einen anfängerfreundlichen Überblick über die Bausteine suchst, bietet dieser Leitfaden zu den Elementen der Musik eine klare Aufschlüsselung.

Die minimalen Grundlagen, die Ihre Ergebnisse mit dem KI-Musikgenerator verbessern:

Rhythmus: wie sich der Groove bewegt (und wo sich die Energie verändert)

Melodie: die einprägsame Topline (Hook-Potenzial)

Harmonie: Akkordstimmung (fröhlich/traurig/angespannt und wie sie sich verändert)

Sobald du diese benennen kannst, kannst du effektiver formulieren („Halbzeit-Bridge“, „Dur-Chorus-Lift“, „synkopierte Hats“).

Rhythmus, Melodie, Harmonie: die 3 grundlegenden Bausteine, die man zuerst lernen sollte

Rhythmus: Das Timing-Muster, das Menschen zum Nicken bringt.

Übung: Klatschen Sie einen gleichmäßigen Puls, und tippen Sie dann ein schnelleres Muster darüber; schätzen Sie die BPM.

Melodie: eine Abfolge von Noten, die man nachsummen kann.

Übung: Summe eine 8-Takt-Phrase und wiederhole sie dann mit einer kleinen Änderung am Ende (Variation).

Harmonie: Akkorde hinter der Melodie, die Emotionen erzeugen.

Übung: Wähle ein Stimmungswort (fröhlich, traurig, angespannt) und probiere 2 Akkordoptionen aus; notiere, was sich ändert.

Eine einfache Liedform, die du wiederverwenden (und in Prompts umwandeln) kannst

Eine zuverlässige, moderne Pop-Form, die Sie wiederverwenden können:

Intro – Strophe – Refrain – Strophe – Refrain – Bridge – Refrain

Dies sind auch die englischen Strukturwörter, die die meisten KI-Songgeneratoren gut verstehen:

Intro

Strophe

Refrain

Brücke

Outro

Wenn Sie Kontrastnotizen hinzufügen, verhält sich das Modell vorhersehbarer:

„Strophe: spärliche Drums, strafferer Gesang“

„Refrain: große Drums, breite Synthesizer, Hook-orientiert“

„Bridge: Half-Time, Breakdown, Spannungsaufbau“

Eine KI-generierte Spur in eine fertige Veröffentlichung verwandeln (grundlegende Postproduktion)

KI kann dich schnell zu 80 % bringen. Die letzten 20 % – grundlegende Nachbearbeitung – entscheiden oft, ob es sich wie eine „Demo“ oder eine Veröffentlichung anhört.

Eine minimale, tool-agnostische Kette:

Bearbeiten (kürzen, anordnen, lange Intros/Outros beheben)

Entrauschen / De-Essing (besonders für Gesang)

EQ (Schlamm entfernen, Härte zähmen, Klarheit hinzufügen)

Kompression (Dynamik kontrollieren, verkleben)

Limiter (finale Lautstärkeregelung)

Exportieren (plattformfreundliche Einstellungen)

Wenn Sie in einem All-in-One-Workflow arbeiten, kann MelodyCraft Ihnen helfen, schnell von einem KI-generierten Entwurf zu etwas Strukturiertem zu gelangen, das bereit zur Verfeinerung ist – besonders, wenn Sie es wie einen Produktionsprozess behandeln, nicht wie einen Spielautomaten.

Schnelle Lösungen für Gesang und Klarheit (EQ-Anpassungen und Arrangement-Optimierungen)

Beginne mit der Anordnung „Subtraktion“, dann EQ. Häufiges Symptom → Behandlung:

Zischlaute (scharfe S/T-Laute): De-Esser leicht anwenden; Höhen leicht absenken, falls erforderlich

Gesang klingt dumpf: kleine Absenkung in den tiefen Mitten; sanfte Anhebung im Präsenzbereich

Gesang zu scharf: schmale Absenkung in den oberen Mitten; aggressivere "helle" Prompt-Wörter beim nächsten Mal reduzieren

Gesang von Instrumenten überdeckt: konkurrierende Parts absenken (Pads/Gitarren), dann kleine Gesangs-Präsenzanhebung

Bassbereich dröhnend: Hochpassfilter für Nicht-Bass-Elemente; Kick/Bass mit sanften EQ-Absenkungen straffen

Praktische Denkweise: Wenn der Gesang mit einer lauten Synth-Lead kämpft, wird EQ ihn nicht retten – entferne oder reduziere zuerst das konkurrierende Element.

Export-Einstellungen für YouTube, TikTok und Podcasts (damit es nicht ruiniert wird)

Plattformen werden Ihr Audio neu codieren. Um die Qualität zu erhalten:

Exportiere eine WAV-Datei zur Archivierung/zum Mastern und eine separate Upload-Datei, falls erforderlich

Verwende gängige Sample-Raten (oft 44,1 kHz oder 48 kHz), abhängig von deinem Video-Workflow

Halte die Lautstärkeziele in einem sicheren Bereich, anstatt extreme Lautstärke zu erzielen (Plattformnormalisierung kann übermäßig laute Master bestrafen)

Ein praktischer, unumstrittener Ansatz:

YouTube/TikTok: Vermeide übermäßige Begrenzung; erhalte Transienten; erwarte Normalisierung

Podcasts: Priorisiere klaren Sprachbereich; halte die Musikbett leiser und weniger hell, um Ermüdung zu vermeiden

Fehlerbehebung: Warum die Ausgabe Ihres KI-Musikgenerators nicht dem entspricht, was Sie angefordert haben

Wenn ein KI-Musikgenerator „danebenliegt“, liegt das normalerweise an einem von wenigen Mustern: schwache Anker, zu viele widersprüchliche Anweisungen oder fehlende Strukturvorgaben. Im Folgenden finden Sie schnelle, zukunftsweisende Antworten (Sie können diese wie einen Mini-Diagnoseablauf behandeln).

„Es ignoriert mein Genre“ – Wie man Stil mit weniger, stärkeren Wörtern verankert

Wenn Genredrift passiert, vereinfache und verankere:

Setze Genre an erste Stelle

Füge Epoche oder Region hinzu (z. B. „UK Garage, 2000er“)

Wähle maximal zwei Ankerinstrumente („Shuffle Hats + Sub Bass“)

Verschiebe dann die wichtigsten Wörter an den Anfang des Prompts. Wenn du tiefer in Prompt-Muster eintauchen möchtest, können Community-Prompt-Diskussionen wie diese hier hilfreich für Iterationsideen sein: So schreibt man großartige Prompts.

„Das Lied ist repetitiv“ – wie man Kontraste zwischen den Abschnitten erzwingt

Wiederholung bedeutet normalerweise, dass das Modell nicht weiß, was sich ändern soll. Erzwinge Kontrast explizit:

„Strophe: spärliche Drums, gedämpfter Bass, intimer Gesang“

„Refrain: große Drums, hinzugefügte Harmonie, breiterer Mix“

„Bridge: Half-Time, neue Akkordfarbe, minimale Drums, Aufbau zurück“

Lyric-Side-Tipps (für KI-Songgenerator-Workflows):

Bitte um neue Bilder in Strophe 2 (nicht umformulierte Strophe 1)

Weise darauf hin, dass die gleiche Anfangszeile in jedem Abschnitt vermieden werden soll

Definiere den Refrain als einen kurzen Slogan, nicht als einen langen Absatz

KI-Musikgenerator – FAQ (schnelle Antworten auf häufige Suchanfragen)

F: Sind KI-Musikgeneratoren kostenlos?

A: Viele bieten kostenlose Stufen oder Testversionen an, aber Exporte, vollständige Songs, Stems und kommerzielle Rechte sind oft von kostenpflichtigen Plänen abhängig.

F: Benötige ich Musiktheorie, um einen KI-Songgenerator zu verwenden?

A: Nein – aber das Erlernen grundlegender Rhythmus-/Struktur-Begriffe (BPM, Strophe/Refrain/Brücke) macht Ihre Prompts klarer und Ihre Ergebnisse konsistenter.

F: Kann ein KI-Musikgenerator den Stil eines bestimmten Sängers oder Künstlers kopieren?

A: Tools und Plattformen schränken oft die Nachahmung ein. Eine schöpfersichere Vorgehensweise ist die Verwendung von breiten Genre-/Epochenbeschreibungen anstelle der Nennung bestimmter Künstler.

F: Kann ich KI-generierte Musik kommerziell nutzen?

A: Oft ja, aber es hängt vom Tool und Ihrem Plan ab. Überprüfen Sie die Lizenzbedingungen und Plattformregeln, bevor Sie veröffentlichen, und bewahren Sie den Nachweis Ihres Plans und der Erstellungsdaten auf.

F: Wie lange dauert es, ein komplettes Lied mit KI zu generieren?

A: Entwürfe können in wenigen Minuten erstellt werden, aber die Auswahl von Takes, die Korrektur von Struktur/Texten und der Export für die Veröffentlichung dauern in der Regel 30–90 Minuten für eine solide erste Version.

Veröffentliche in wenigen Minuten fertige Musik 🎵

Verwandle deine Idee schnell in einen fertigen Track. Keine technischen Fähigkeiten erforderlich.