製品機能、コンテンツパイプライン、またはクリエイティブツールでStable Audioを評価している場合、通常は3つの質問があります。何が生成できるのか、Stable Audio APIドキュメントはどこにあるのか、そしてStable Audio APIの価格は規模に応じてどのようになるのか。このガイドでは、開発者第一の視点からこれらの決定事項を説明します。これには、実践的なStable Audio 2.5 APIフローと、Stable Audio 2.0の2026年の価格など、バージョン固有の価格を慎重に検証する方法が含まれます。3行のまとめ

以下のセクションでは、ランディングページを過ぎてから通常重要になる部分に焦点を当てています。Stable Audioがさまざまなインターフェースを通じてどのように公開されているか、最初にドキュメントのどこを読むべきか、価格設定についてどのように考えるか、バージョン固有の質問で追加の確認が必要な場所について説明します。

3行まとめ

プロバイダーのドキュメント(認証 → リクエストスキーマ → 非同期/ストリーミング → エラー)から始めて、プロンプトを調整する前に確認してください。

「1リクエスト=1コスト」ではなく、プロバイダーが請求する内容(クレジット、期間、再試行)で予算を立ててください。

「Stable Audio 2.0の2026年の価格」を検証タスクとして扱い、実際に使用しているプラットフォームでモデルIDと価格表を確認してください。

以下に移動

Stable Audioとは何ですか?また、現在どのようなものを生成できますか?

実際的なレベルでは、Stable Audioは、短い音楽のアイデア、サウンドデザイン要素、バリエーションを作成するために使用できるオーディオ生成システムです。テキストのみから、または既存のオーディオを変換して作成できます。具体的な製品の表面や統合するAPIによって異なります。ほとんどのチームは、迅速なプロトタイピング、コンテンツのバリエーション(広告、ソーシャル)、ゲームのSFX/音楽スケッチ、およびレイテンシーとコストが重要なクリエイターツールとして評価しています。

日常的な使用では、通常、大きく分けて2つの生成モードが見られます。

Text-to-audio: どのようなオーディオが欲しいか(ジャンル、楽器、ムード、テンポ、ミックス)を記述すると、モデルが新しいオーディオを生成します。

Audio-to-audio: 入力オーディオクリップを提供し、変換(バリエーション、リスタイル、インペインティングのような編集、または「同じアイデアで異なるプロダクション」)を要求します。選択したエンドポイントがサポートするものに従います。

機能に関する標準的な製品概要や公式な位置付けについては、Stability AIのStable Audioのランディングページから始めてください: Stability AIによるStable Audio。そこから、あなたがソロクリエイター(インタラクティブUIで十分かもしれません)なのか、開発者/チーム(予測可能な請求、レート制限、およびサポートの期待値を持つAPIプロバイダーのパスが必要になります)なのかを判断してください。

Stable Audioの「パートナー」と「公式API」:開発者にとっての違いは何ですか?

開発者は、「Stable Audio」にアクセスするためのエントリーポイントが複数あるため、混乱することがよくあります。Stability AI独自の製品、公式API、そしてモデルをマネージドエンドポイントとしてホストまたは公開するパートナープラットフォームなどです。認証、クォータ、可観測性、再試行、価格表示など、本番環境で重要なあらゆることにおいて、この違いが重要になります。

これについて考える簡単な方法:

具体的なパートナー形式の例として、falなどのプロバイダーで見られるモデル一覧表示があります(エンドポイントのタイプと価格表示を迅速に理解するのに役立ちます)。Stable Audio 2.5 (audio-to-audio) モデルページをご覧ください。

コードを書く前に、どの「サーフェス」で出荷するか(公式かパートナーか)を決定します。次に、チームが常にデプロイされたものを検証できるように、プロジェクトのREADMEにモデルID + 価格ページURL + ドキュメントURLを固定します。

Stable Audio API のドキュメントの場所 (および最初に読むべきもの)

当面の目標がStable Audio APIのドキュメントである場合は、まず提供元固有のリファレンスから、提供予定のエンドポイントに関する情報を確認してください。たとえば、パートナーのエンドポイントを統合する場合は、こちらのAPIリファレンスから始めることができます:Stable Audio 2.5 audio-to-audio APIドキュメント。

最初に読むべきもの(順番に)時間を無駄にしないために:

認証: APIキーの渡し方、必須ヘッダー、スコープ/パーミッションの仕組み。

リクエストスキーマ: 正確なフィールド名、データ型、最小/最大値(期間制限は最初の驚きであることが多い)。

レスポンススキーマ: 出力オーディオのURL/blobの場所、および帰属/ロギングに必要なメタデータ。

非同期 vs 同期: 生成がキューに入れられ、ポーリング/コールバックが必要かどうか、および結果が利用可能な期間。

エラーコードとレート制限: 特に401/403認証エラー、429スロットリング、およびタイムアウトの動作。

ドキュメントをパラメータ名とデフォルトの信頼できる情報源として扱ってください。わずかな不一致(秒とミリ秒、durationとduration_secondsなど)でも、混乱を招くエラーが発生する可能性があります。

認証とAPIキー:初回リクエスト前に陥りやすい落とし穴

「最初の要求が失敗した」という問題のほとんどは、モデルの問題ではなく、認証、環境、またはクォータの問題です。プロンプトをデバッグする前に、このチェックリストを使用してください。

プリフライトチェックリスト

APIキーを環境変数に保存する(リポジトリやクライアントアプリへのハードコーディングを避ける)。

キーが正しいワークスペース/プロジェクトのものであることを確認する(チームは複数のワークスペース/プロジェクトを持っていることが多い)。

モデルへのアクセスが有効になっていることを確認する(プロバイダーによっては、特定のモデル、地域、またはティアを制限している場合がある)。

負荷テストの前に、使用量上限/クレジットを確認する(突然の停止はネットワークのバグのように見えることがある)。

プロバイダーが時間ベースの署名を使用している場合、サーバーの時計が正確であることを確認する(プロバイダーによって異なる)。

よくあるエラー → 考えられる原因 → 簡単な修正

公式およびパートナーのサーフェスでは制限が異なる場合があるため、呼び出している正確なエンドポイントのドキュメントを必ず相互に確認してください。

リクエストスキーマの基本:プロンプト、継続時間、入力音声(音声to音声)

Stable Audio APIドキュメントでは、最も重要なフィールドは、(a)何が生成されるか、(b)いくら支払うかを決定するものです。正確な名前はプロバイダーによって異なりますが、一般的に以下のようなものが表示されます。

prompt: テキストによる説明 (ジャンル + 楽器編成 + ムード + 構成 + ミックスに関する注記)。duration/duration_seconds: 目標とする出力の長さ。これはしばしばコストと実行時間に影響します。input_audio(オーディオからオーディオへ): アップロード、URL、または base64 ペイロードのいずれか—および、出力が入力にどれだけ強く準拠するかを制御するオプションのパラメータ (フィールド名は異なります)。オプションの seed / randomness コントロール: サポートされている場合、これらは出力の再現に役立ちます。サポートされていない場合は、ワークフローレベルの一貫性のトリックを使用します (後述)。

オーディオ間のリクエストに対する最小限の「形状」(疑似構造。エンドポイントのドキュメントで正確なキーを確認してください):

環境変数に

API_KEYを設定してください次の内容でリクエストを送信してください:

prompt: “Lo-fi hip hop beat, warm vinyl noise, 85 BPM, mellow keys, tight kick”duration_seconds: 15input_audio: クリップの参照(ドキュメントに従ってURL/アップロード/base64)次の内容を含むレスポンスを受信します:

出力オーディオのURLまたはファイル参照

追跡用のリクエスト/ジョブID(特に非同期の場合)

ドキュメントに記載されていないデフォルト値に頼ることは避けてください。ドキュメントにデフォルト値(期間、サンプルレート、または強度など)が明確に記載されていない場合は、リクエストで明示的に設定して、プロバイダーの更新時に本番環境の動作が変更されないようにしてください。

Stable Audio 2.5 API をエンドツーエンドで呼び出す方法(実践的なフロー)

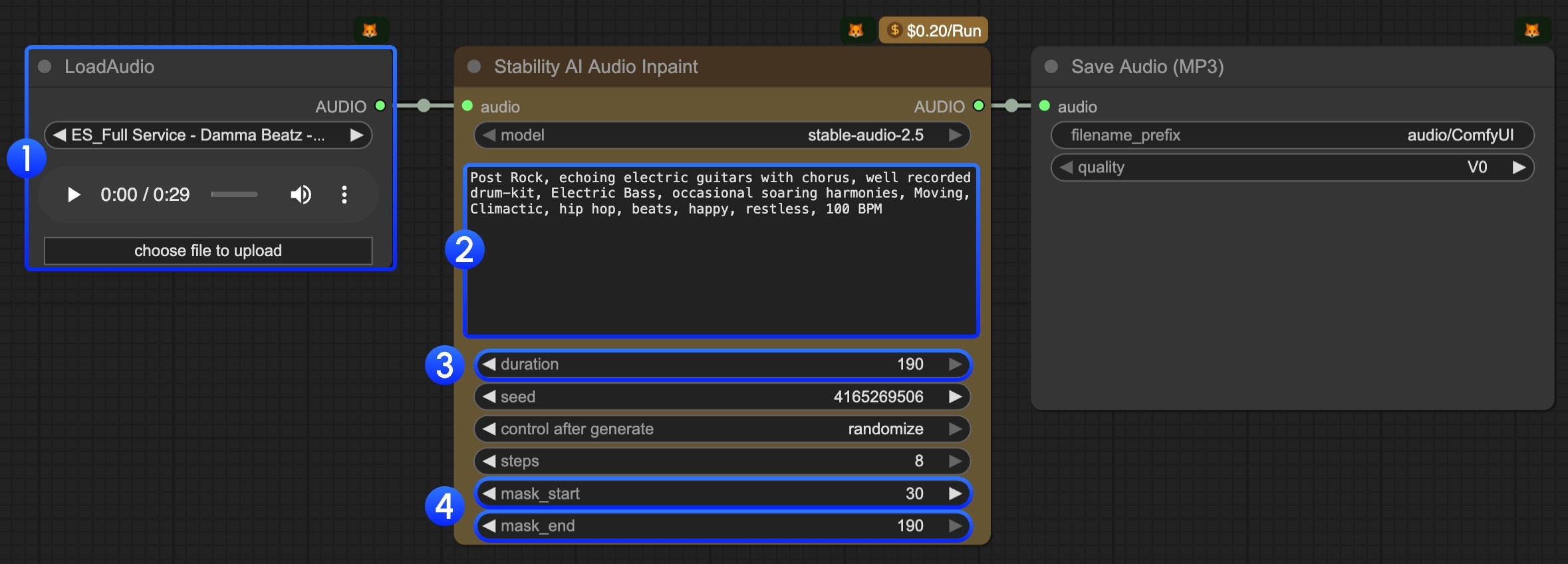

本番環境に対応したStable Audio 2.5 APIの統合は、単一のPOSTリクエストにとどまらず、アセットの準備、ジョブの制御、ダウンロード/ストレージ、可観測性といった周辺のワークフロー全体に関わります。(特にノードベースのツールを使用している場合に)役立つ概念的なウォークスルーとして、こちらのパートナーチュートリアルをご覧ください:ComfyドキュメントのStable Audio。

実践的な「0から1へ」の流れは次のようになります。

アセットの準備

オーディオからオーディオへの変換を行う場合は、入力クリップをノーマライズしてください。一貫したラウドネス、無音部分のトリミング、サポートされている形式/サイズ(正確な要件はプロバイダのドキュメントによって異なります)が必要です。

後で必要になるメタデータを事前に計算しておきます。ユーザー ID、プロンプトのバージョン、モデル ID、アプリにコンテンツポリシーフラグがある場合はそれも計算しておきます。

生成リクエストを送信

送信するペイロード全体(シークレットを除く)を保存し、後でデバッグや再現に利用できるようにします。

プロバイダーがサポートしている場合は、べき等キーを添付します(リトライが発生した場合の二重請求を防ぎます—プロバイダー固有)。

非同期実行を処理する

多くのオーディオ生成がキューに入っています。可能な場合は、非同期ジョブパターンを推奨します。

バックオフ付きのポーリング、またはサポートされている場合はWebhook/コールバックを実装します。

ダウンロードと出力の保存

生成されたファイルを、一時的なプロバイダーのURLに依存しないように、独自のストレージ(S3/GCS/R2)に保存します。

メタデータを保存します:モデルのバージョン、パラメーター、タイムスタンプ、およびシードのようなフィールド。

再利用、反復、A/Bテスト

プロンプトテンプレートと、各ユースケース(広告のサウンドロゴ、ゲームUIのSFX、ローファイのループ)に最適な「既知の良好な」設定を保存します。

バッチでバリエーションを生成し、人間のレビューまたは軽量なオーディオ機能チェックを使用して、勝者を選択します。

テキストからオーディオか、オーディオからオーディオか:どちらのエンドポイントパターンがあなたのユースケースに合っていますか?

適切なエンドポイントパターンを選択することは、より少ないリトライ(そして請求額での驚きも少なく)でより良い出力を得るための最も速い方法です。

プロバイダーが両方を提供している場合、最初のドラフトにはテキストからオーディオを使用し、方向性を「固定」して制御されたバリアントを作成するためにオーディオからオーディオを使用するのが一般的です。

出力の一貫性を高める:シード、反復、およびプロンプトの構造

一貫性は通常、楽しいデモと出荷可能な機能の違いです。あなたの目標は、予算を浪費して強引に進めることがないように、入力(プロンプト、設定、参照)のランダム性を減らすことです。

エンドポイントがシードをサポートしている場合

生成されたすべてのアセットにシードを保持します。

プロンプトを安定させ、一度に1つの変数のみを変更します(楽器、BPM、またはムード—3つすべてではありません)。

エンドポイントがシードをサポートしていない場合(またはシードの動作が異なる場合)

固定されたプロンプトテンプレートを使用し、明確な音楽とミックスの要件で制約します。

構造を固定するために、一貫したリファレンスクリップでオーディオ to オーディオを使用します。

小さなセット(例:4〜8)をバッチ生成し、1つずつ繰り返し再生成するのではなく、最も近い一致を選択します(これにより、選択プロセスにおける「ドリフト」が軽減されることがよくあります)。

再利用可能で、的を射やすいプロンプトの構造:

Style/genre: “ミニマルテクノ、倉庫の雰囲気”

Tempo & groove: “125 BPM、安定した四つ打ち”

Instrumentation: “タイトなキック、オフビートのハット、モノラルベース”

Mood: “ダーク、緊張感、催眠的”

Mix notes: “パンチの効いたローエンド、制御されたハイ、軽いリバーブ”

Negative constraints: “ボーカルなし、長いイントロなし、ジャズコードは避ける”

クリエイターフレンドリーなイテレーションのために、MelodyCraftのような音楽アプリでプロンプトテンプレートやバリエーションを試作してから、APIプリセットに組み込むこともできます。

Stable Audio API の価格:クレジットと実際のコストの関係

Stable Audio APIの価格設定は、プラットフォームによってわかりやすい場合とわかりにくい場合があります。クレジットで請求するプラットフォームもあれば、リクエストごとの価格を表示するプラットフォームもあり、多くのプラットフォームが実質的に出力時間(および場合によっては品質設定)で価格を設定しています。公式な価格変更とクレジットの定義に関する最も信頼できる出発点は、Stability AIの更新投稿です:API pricing update。

当て推量なしでコストを見積もるには、次の3つの質問を中心に予算モデルを構築します。

課金単位: クレジット、秒、リクエスト、またはハイブリッド?

使用量としてカウントされるもの: 成功した生成のみか、失敗/再試行されたジョブもクレジットを消費するか? (これはプロバイダーによって異なります—請求ドキュメントで確認してください。)

上限と階層: 1回の呼び出しあたりの最大時間、同時実行性、および上位階層でより良いスループットがアンロックされるかどうか。

今日から使える簡単な見積もり方法:

平均的なリクエスト時間を決定します(例:10秒、15秒、30秒)。

予想されるリトライ率を決定します(例:本番環境の初期段階では5〜15%。プロンプトと検証を改善するにつれて調整します)。

プロバイダーのクレジット/ユニット表を掛けて、バッファーを適用します。

コスト範囲の例の表(プロバイダーの数値を入力してください)

重要なのは、「1,000世代」は、期間、エンドポイントのタイプ、および再試行の動作を定義するまで、コストの数値ではないということです。

テキストからオーディオへの変換とオーディオからオーディオへの変換の価格設定:出荷前に確認すべきこと

両方のモードが利用可能な場合でも、テキストからオーディオとオーディオからオーディオでは価格が異なる(または上限が異なる)場合があります。リリースする前に、本番環境でユニットエコノミクスを発見しないように、この7項目のチェックを行ってください。

ローンチチェックリスト(価格 + 制限)

呼び出す正確なエンドポイントとその単価(クレジット/秒/リクエスト)を確認してください。

最大リクエストごとの継続時間と、長い音声にチャンクが必要かどうかを確認してください。

同時実行制限(1分あたりのリクエスト数、並列ジョブ数)を確認してください。

失敗と再試行の課金ルールを確認してください(プロバイダー固有、想定しないでください)。

入力オーディオのアップロード/ダウンロード帯域幅がコストに影響するかどうかを確認してください(通常は別ですが、異なります)。

「品質」または「ステップ/反復」パラメーターが価格を変更するかどうかを確認してください(公開されている場合)。

出力保持期間(プロバイダーが生成されたファイルをホストする期間)を確認してください。

上記のいずれかがドキュメントに明記されていない場合は、リスクとして扱い、少額の有料パイロットでテストしてください。

プロバイダーの料金例:「音声1件あたり0.2ドル」とは、実際には何を意味するのか

一部のパートナープラットフォームでは、「音声あたり0.2ドル」のようなシンプルなラベルが表示されます。これを正しく解釈するには、「このエンドポイントのデフォルトの前提条件に基づくリクエストあたり0.2ドル」と考えるべきです。実際のコストは、プロバイダーが課金対象の単位と見なすものによって、高くなることも低くなることもあります。

モデルページの価格表示を起点として、請求書やインボイスと照合して検証してください。例:Stable Audio 2.5 audio-to-audioモデルページ。

一般的に実際の費用を変更するもの(多くはプロバイダーに依存するため、確認されるまで推論として扱ってください):

Duration overrides: UIに単一の数値が表示されていても、音声が長くなるとコストが高くなる場合があります。

Retries: ネットワークのリトライやタイムアウトは、冪等性を使用しない場合、重複したジョブを作成する可能性があります。

Parameter changes: 「高品質」モード、追加のパス、または高度な機能は、請求額を変更する可能性があります。

Batching: 1回の呼び出しで4つのバリエーションを生成するのと、4回の個別の呼び出しを行うのとでは、料金が異なる場合があります(API設計によって異なります)。

予測可能な支出を希望する場合は、エンドポイント名、期間、ペイロードサイズ、ジョブ ID、およびリクエストごとに最終的に請求されるユニット数を記録し、毎週照合してください。

Stable Audio 2.0 の2026年の価格:これは別のプランなのか、またその確認方法について。

人々が“stable audio 2.0 pricing 2026”と検索するのは、"2.0"の料金体系が新しいバージョン(2.5など)と異なるのか、それとも統一されたクレジットテーブルに組み込まれているのかを判断しようとしているからです。最も安全な方法は、決めつけずに、再現可能な証拠を使って確認することです。

クリーンな検証ワークフローを以下に示します。

まず、公式の価格更新情報を確認する:Stability AIの価格更新ページで、クレジットがモデルにどのように対応しているか、バージョン名が明示的に記載されているかどうかを確認してください:APIの価格更新。

プロバイダーでモデル名/バージョンを確認する:エンドポイントのリストとドキュメントで、正確なモデル識別子(例:「stable-audio-2.5」と「stable-audio-2.0」)を探してください。

請求ページ/請求書で相互確認する:テスト生成を実行したときに、実際にどのSKU/モデルIDが請求されているかを特定します。

チームのために証拠を保存する:価格ページと使用したモデルIDのスナップショット(日付+ URL)を保存して、後で価格に関する議論が推測にならないようにします。

このアプローチは、公式のAPIサーフェスを使用している場合でも、パートナーマーケットプレイスを使用している場合でも有効です。なぜなら、どちらの場合でも、「実際の価格」は、実行したモデルIDに対して課金システムが記録する価格だからです。

Stable Audio 2.0 の価格が見つからない場合の考えられる理由(と対処法)

2.0の個別の項目が見つからない場合、通常、次のいずれかのシナリオが原因です。

バージョンの統合: 価格は「2.0」というラベルではなく、より広範な「Stable Audio」または「Audio」カテゴリに記載されています。

モデルの廃止または名前の変更: プラットフォームは、古い名前を強調することなく、ユーザーを新しいモデルIDに移行した可能性があります。

異なるエントリポイント: 公式製品とパートナー製品では、価格が異なる場合があります。

エンタープライズ限定の条件 (推論): 一部の使用権または価格は、公開テーブルではなく、営業を通じて交渉される場合があります。

次にすること:

モデル ID、リクエスト ID、および料金が表示されるはずの場所のスクリーンショットを添えて、プラットフォームサポートにお問い合わせください。

管理されたテスト(1つのリクエスト)を実行し、請求書/エクスポートでどのように表示されるかを確認してください。

料金が再度変更された場合に備えて、日付を含め、エンジニアリングノートに結果を記録してください。

ライセンスと商用利用:オーディオ公開前にチームが確認すべきこと

Stable Audioで生成されたものを公開する前に、使用した正確なインターフェース(公式プラットフォーム対パートナープラットフォーム)のライセンスと商用利用規約を確認してください。規約はプロバイダーやプランによって異なる場合があるため、コミュニティの要約に頼るのではなく、必ず関連する規約ページで確認してください。

チームのための実践的なコンプライアンスチェックリスト:

プランおよび選択したエンドポイントで商用利用が許可されているか確認してください。

公開されたオーディオに対する帰属要件(もしあれば)を確認してください。

広告、ゲーム、ポッドキャスト、またはストックライブラリで出力を使用できるか確認してください(利用規約は配信タイプによって異なることがよくあります)。

データ処理を確認してください:プロンプト/オーディオ入力が保持されるかどうか、およびトレーニングに使用される可能性があるかどうか(プロバイダー固有)。

禁止コンテンツ(例:なりすまし、著作権で保護されたメロディー、ブランドのサウンドアライク)に関する社内ポリシーを確認してください。

これは法的助言ではありません。早い段階で適切な質問をするための運用チェックリストとして扱ってください。

Stable Audio vs Suno vs Udio:Stable Audio がより安全な選択肢となるのはどんな時か

チームがStable AudioとSuno、Udioを比較する際、「最適な」選択は、生の出力品質だけでなく、デプロイの制約、ワークフロー、リスク許容度によって異なります。Stable Audioは、いくつかの一般的なケースにおいて、より安全な選択肢となります。

デプロイメントと移植性に関するより明確なシグナルが必要です(例:TechCrunchの記事で議論されているように、より小型/エッジ対応のオーディオモデルへの関心:Stability AI releases an audio generating model that can run on smartphones)。

明示的なモデルIDと予測可能な可観測性を備えた、APIファーストの統合パスが必要です。

あなたの組織は特に知的財産のリスクに敏感であり、コミュニティの逸話だけでなく、文書化された条件と信頼できる報告に基づいて意思決定を行いたいと考えています。

シンプルな決定表:

出力の違いに関する別の視点として、コミュニティの比較レビューも参照できます(その後、独自のプロンプトをテストして検証してください)。Udio vs Suno の比較概要。

人々が最も尋ねる質問:品質、ボーカル/歌詞、そして知的財産のリスク

Q: Stable Audioは、他のジェネレーターと比較して「高品質」ですか?

A: 品質は、エンドポイント/バージョン、継続時間、プロンプトの精度に大きく左右されます。ほとんどのチームにとって、実用的な尺度は「許容できる出力が得られるまでに何回生成する必要があるか」です。なぜなら、それがUXとコストの両方を左右するからです。

Q: Stable Audioはボーカルや歌詞を生成できますか?

A: Stable Audioの特定のバージョンと、使用しているプラットフォームのインターフェース(インストゥルメンタル/サウンドデザインに特化したエンドポイントもあります)によって異なります。プロバイダーのドキュメントで機能リストを確認し、短い評価セットでテストしてください。

Q: どの程度制御できますか (構成、テンポ、楽器編成)?

A: 制御は、(1) テンポ/グルーヴを指定する、(2) 楽器編成を制限する、(3) 反復処理中は短い時間にする、(4) タイミング/構成を維持する必要がある場合はオーディオ to オーディオを使用すると向上します。

Q: IPリスクについてはどうですか?

A: リスクを排除できるモデルはありません。最も安全な運用姿勢は、プラットフォームの規約に従い、「そっくりそのまま」の現存するアーティストや認識可能な楽曲を求めるプロンプトを避け、出所を明らかにするためのログを保持し、商用リリースのためのレビュープロセスを実行することです。研究の方向性やリスクの枠組みを評価する場合は、関連する学術的な議論(技術的な背景について)をざっと読むこともできます:https://arxiv.org/html/2506.19085v1

Stable Audio の出力トラブルシューティング:よくある5つの失敗とその修正

最も安定したオーディオの「失敗」は、より厳格な制約、より短いイテレーションループ、およびより優れた入力検証で修正できます。機能(単なる実験ではない)を構築している場合は、トラブルシューティングを製品設計の一部として扱います。許容できる出力を定義し、リクエストの制約を強制し、すべてをログに記録します。

以下は、最も一般的な5つの問題と、それぞれの問題に対する2つの即時的な調整方法です。

1) 出力がプロンプトから逸脱する(ジャンル/楽器が違うなど)

調整 A: 主要な制約を先頭に移動: 「インスト、ボーカルなし。90 BPM。アコースティックキット + エレキベース。」

調整 B: 否定的な制約を追加: 「EDM スーパーソウを避ける、オーケストラストリングスを避ける。」

2) 音楽が構造化されていない、またはまとまりがないように感じる

調整A:イテレーションを行いながらデュレーションを短くする(例:8〜15秒)。適切なモチーフが得られたら、スケールアップのみを行います。

調整B:構造の合図を指定する:「短いイントロ、メインループ、クリーンなエンディング」(サポートされている動作は異なりますが、多くの場合役立ちます)。

3) クリッピング、耳障りな高音、または歪み

調整 A: ミックスの制約を追加: 「クリッピングなし、制御された高音、適度なラウドネス」。

調整 B: 入力オーディオをノーマライズし (オーディオ to オーディオの場合)、極端に大きなリファレンスは避けてください。

4) 誤った期間 (短すぎる/長すぎる)

調整 A: ドキュメントから正しい期間のフィールド名/単位を設定していることを確認してください。

調整 B: エンドポイントに最大期間がある場合は、リクエストをチャンク化し、ダウンストリームをステッチします。

5) バリエーション間でスタイルに一貫性がない

調整 A: 固定のプロンプトテンプレートを使用し、リクエスト全体で単一の「スタイルライン」を一定に保ちます。

調整 B: 音色とグルーヴを固定するために、一貫したリファレンスクリップを使用したオーディオ to オーディオを優先します(利用可能な場合)。

Stable Audioの生成と反復に関する実践的なワークフローのヒントについては、Comfyのチュートリアルと実践的なガイドも参考になります。Stable Audioのチュートリアルと、DigitalOceanの実践者向けのチュートリアル:https://www.digitalocean.com/community/tutorials/stable-audio-music-generation

APIエラーのデバッグ:タイムアウト、レート制限、および不正な入力

出力品質は問題ないが、統合が不安定な場合は、プロンプトエンジニアではなく、APIエンジニアのようにデバッグしてください。一貫したインシデントチェックリストを使用します。

リクエスト ID (プロバイダーのレスポンスから) を記録し、アプリのジョブ ID にアタッチします。

送信した生のペイロードを保存します (シークレットは削除)。これにより、再現できます。

送信前にインプットを検証します:

オーディオ形式、再生時間、ファイルサイズ (エンドポイントのドキュメントに従って)

必須フィールドが存在し、許容範囲内であること

429 エラーに対するバックオフを実装します: 指数バックオフ + ジッター; 最大再試行回数を制限; サンダリングハードを回避します。

タイムアウトを明示的に処理します:

利用可能な場合は、非同期ジョブの送信を使用します

プロバイダーが推奨する場合にのみ、クライアントのタイムアウトを増やします

タイムアウトを「不明な状態」として扱い、盲目的に再試行するのではなく、ジョブ ID で調整します

パートナープロバイダーでStable Audio 2.5のオーディオ to オーディオのエンドポイントを使用している場合は、フィールド名と制約をデバッグする際に、APIリファレンスを開いたままにしてください:Stable Audio 2.5 オーディオ to オーディオ APIドキュメント。